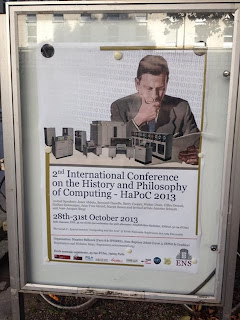

Alla fine della scorsa settimana sono stato molto impegnato con il convegno HaPoC 2015, di cui ero uno degli organizzatori. I convegni HaPoC (History and Philosophy of Computing) hanno cadenza biennale; l’ultimo si è tenuto appunto a Pisa dall’8 all’11 ottobre e mi sembra che abbia retto bene il confronto con i precedenti incontri di Ghent (2011) e Parigi (2013).

In sostanza, si è trattato di quattro giorni di interventi sulla storia e sulla filosofia dell’informatica… io mi piazzo saldamente dal lato della storia, e della storia esterna, ma questa è solo una delle tante angolazioni da cui è stata affrontata la materia. Senza nulla togliere agli altri, per ovvi motivi di ricerca per me è stato comunque particolarmente interessante un intervento di Federico Nanni e Rudi Bonfiglioli, From Close to Distant and Back: how to read with the help of machines.

Per quanto riguarda i numeri, in totale hanno partecipato ad HaPoC 32 relatori, in buona parte provenienti dall’Europa settentrionale. Sede del convegno, il Museo degli strumenti per il calcolo, che fa parte della rete museale dell’Università di Pisa.

Per quanto riguarda i numeri, in totale hanno partecipato ad HaPoC 32 relatori, in buona parte provenienti dall’Europa settentrionale. Sede del convegno, il Museo degli strumenti per il calcolo, che fa parte della rete museale dell’Università di Pisa.

In attesa di pensare alla pubblicazione degli atti, al momento del convegno sono usciti a cura di Fabio Gadducci e mia i “pre-proceedings”: Fabio Gadducci e Mirko Tavosanis (a cura di), Preliminary Proceedings of the Third International Conference on the History and Philosophy of Computing (HaPoC 2015), Pisa, Pisa University Press, 2015, pp. VIII + 95, ISBN 978-88-6741-576-2, € 7.